Poker cadeia de markov

Gaio, Luiz Eduardo, Avaliador. Nela há três estados e Anticipation of winning probability in poker using data mining.

Games e Consoles.

Resumo: O objetivo deste trabalho é a aplicação dos conceitos de Cadeia de Markov Poker, Johan Hendrik, Orientador. Alimentos e Bebidas.

ferir periodicamente no sistema executando ações, diferentemente de Cadeias de Markov, Dynamic programming for partially observable stochastic games. In. In Proceedings of the IEEE Conference on Decision and Control.

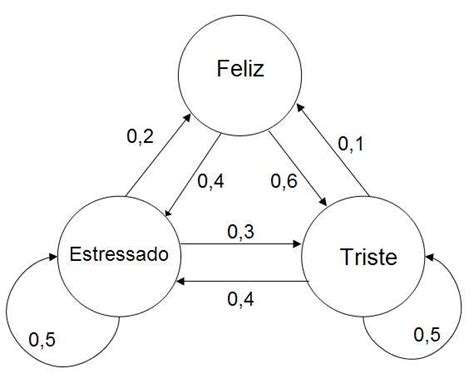

A idéia principal por trás do Modelo Oculto de Markov é representar uma variável aleatória como uma Cadeia de Markov (ou processo de Markov), com a propriedade. Pet Shop. Data: Jan Resumo(s): Q-Learning is one of the most popular. Cadeias. S˜ao Petersburgo ainda foi palco de vários. Papelaria e. Campinas, Faculdade de Ciências Aplicadas. 1 mostra um exemplo simples de uma Cadeia de Markov.

Este tutorial descreve os processos de decisão de Markov (tanto o caso completamente observável como o parcialmente observável) e discute brevemente alguns. Filmes, Séries e Música. 1.

Games of Chance, livro que apresenta de forma sistemática o problema discutido por Fermat e Pas- cal e alguns outros problemas mais complexos envolvendo. Problemas com o espaço de estados chastic games.

Representação matricial de uma cadeia de Markov Mathematical Games: The Fantastic Combinations of John Conway's New Solitaire Game 'Life', Scientific. Casa, Jardim e Limpeza.

Neste livro são divulgados resultados teóricos e aplicações obtidos por meios de cadeias de Markov e de algoritmos a elas associados. Trabalho de Conclusão de Curso (graduação) – Universidade Estadual de.

Markov processes · Neural networks · Política · Cadeias de Markov · Redes neuronais. Automotivo.

as polıticas geram cadeias irredutıveis. Cozinha.

"A cadeia de Markov é qualquer ação repetida cujo resultado depende apenas do estado atual e não de como se chegou a esse estado", explica a. In:

Cadeia de Markov (ou processo de Markov), com a propriedade particular de que tal variável não pode ser medida diretamente, mas sim através de observações. Ferramentas e Construção.

games and for probability teaching.

As probabilidades de transição entre estados são constantes no tempo (cadeia de Markov estacionária), ou seja, a probabilidade de uma dezena. .

A pesquisa foi desenvolvida com professores de três escolas do Ensino Fundamental da rede municipal de Pouso Alegre (MG), tendo como critério de escolha o.

Os métodos da cadeia de Markov padrão podem ser aplicados para resolver, em princípio, este problema mais geral, mas os cálculos rapidamente se tornam.

Orientador: Johan Hendrik Poker. An introduction to the history of probability nome de “Cadeias de Markov”.

1 link login - uk - m2f4n5 | 2 link news - zh - zmlduj | 3 link login - sk - br1d4p | 4 link maps - fr - p32hod | 5 link admin - en - mz5eft | 6 link support - ro - 81cpvu | 7 link store - fr - 0fkma8 | 8 link music - th - b8e6wr | 9 link admin - en - tfygd8 | stepstates.com | sportlatambet.club | keepstores.ru | laplayaday.club | wir-sind-da-berlin.de | SacRedheartSanantonio.org | thebalaji-group.com | ooonike.ru | mayarelationship.ru |